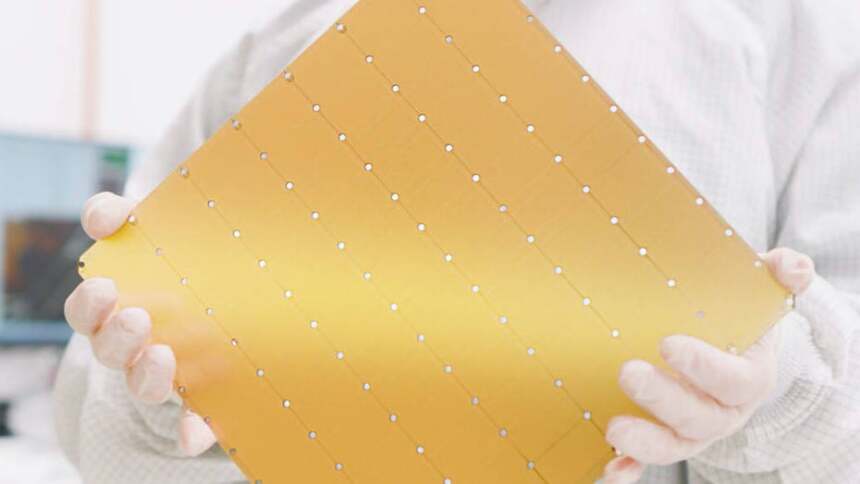

Με το Wafer Scale Engine 3 (WSE-3), ο ειδικός στους υπερυπολογιστές Cerebra παρουσίασε το μεγαλύτερο και πιθανότατα ισχυρότερο τσιπ υπολογιστή στον κόσμο. Το WSE-3 έχει διαστάσεις 21,5 x 21,5 εκατοστά – δηλαδή το ίδιο μέγεθος με τον προκάτοχό του WSE-2 από το 2021. Ωστόσο, προς το παρόν δεν υπάρχουν μεγαλύτερα wafers, οπότε ένα τσιπ δεν μπορεί να γίνει μεγαλύτερο.

WSE-3: Διπλάσια ταχύτητα από τον προκάτοχό του

Εντούτοις, το WSE-3 είναι δύο φορές πιο γρήγορο και ισχυρό από τον προκάτοχό του.

Το τσιπ-τέρας έρχεται με τέσσερα τρισεκατομμύρια τρανζίστορ και 900.000 πυρήνες τεχνητής νοημοσύνης. Συγκριτικά, ο προκάτοχός του WSE-2 είχε 2,6 τρισεκατομμύρια τρανζίστορ και 850.000 πυρήνες AI.

Ένα από τα πιο ισχυρά τσιπ που χρησιμοποιούνται σήμερα για την εκπαίδευση AI είναι η GPU H200 της Nvidia, η οποία έχει “μόνο” 80 δισεκατομμύρια τρανζίστορ, όπως εξηγεί το livescience.com.

Υπερυπολογιστής για την εκπαίδευση συστημάτων AI

Η εκπαίδευση της τεχνητής νοημοσύνης πρόκειται να είναι ένα από τα κύρια καθήκοντα των υπολογιστών που τροφοδοτούνται από τον WSE-3 στο μέλλον. Σύμφωνα με την εταιρεία, το γιγαντιαίο τσιπ προορίζεται για τον υπερυπολογιστή Condor Galaxy 3, ο οποίος βρίσκεται υπό κατασκευή στο Ντάλας του Τέξας και όταν ολοκληρωθεί θα έχει υπολογιστική ισχύ οκτώ exaflops.

Αυτό θα καταστήσει τον Condor Galaxy 3 σχεδόν οκτώ φορές ταχύτερο από τον υπερυπολογιστή Frontier στο Εθνικό Εργαστήριο Oak Ridge στο Τενεσί. Το σημερινό κορυφαίο σύστημα στην κατάταξη των υπερυπολογιστών επιτυγχάνει 1,2 exaflops. Όταν ο Condor Galaxy 3 συνδυαστεί με τους δύο προκατόχους του, το συνολικό σύστημα θα πρέπει να είναι σε θέση να επιτύχει ακόμη και 16 exaflops.

Συστήματα 10 φορές μεγαλύτερα από τον GPT-4 μπορούν να εκπαιδευτούν

Ο Condor Galaxy 3 θα χρησιμοποιηθεί για την εκπαίδευση συστημάτων τεχνητής νοημοσύνης στο μέλλον. Ο υπερυπολογιστής θα πρέπει να είναι τόσο ισχυρός ώστε να μπορεί εύκολα να εκπαιδεύσει συστήματα τεχνητής νοημοσύνης που είναι έως και δέκα φορές μεγαλύτερα από το GPT-4 της OpenAI ή το Gemini της Google, για παράδειγμα.

Σύμφωνα με μια πρόσφατη διαρροή, το GPT-4 λέγεται ότι χρησιμοποιεί 1,76 τρισεκατομμύρια μεταβλητές (παραμέτρους) για την εκπαίδευση του συστήματος. Το Condor Galaxy 3 θα μπορούσε να χειριστεί συστήματα τεχνητής νοημοσύνης με περίπου 24 τρισεκατομμύρια παραμέτρους, σύμφωνα με την Cerebras. Σύμφωνα με τον διευθύνοντα σύμβουλο της Cerebras Andrew Feldman, το Megachip και οι υπερυπολογιστές θα μπορούσαν να βοηθήσουν στην επίλυση “των μεγαλύτερων σημερινών προβλημάτων AI”.